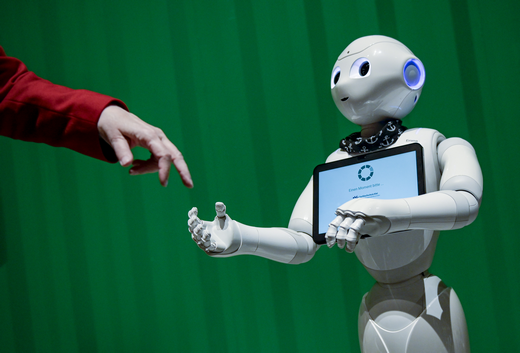

Crédit photo: AP

BRUXELLES (Agefi-Dow Jones)--Fierté et enthousiasme étaient de mise mercredi au Parlement européen de Strasbourg, où les eurodéputés ont adopté leur version de l'"AI Act", ce projet d'encadrement de l'intelligence artificielle, qui positionne l'Union européenne en pionnière à travers le monde démocratique.

Mais, en marge de l'hémicycle, une petite musique empreinte de scepticisme a commencé à se faire entendre en Europe ces dernières semaines. Et si l'Union qui accuse déjà, vis-à-vis des Etats-Unis et de la Chine, un retard important en matière d'innovation, était en train de se tirer une balle dans le pied, en établissant une réglementation à la fois trop stricte et trop précoce ? Avant même de se pencher sur le cas des IA génératives - type ChatGPT - que le Parlement propose d'encadrer, le projet de l'UE suscite l'inquiétude d'entreprises européennes exploitant des technologies "plus classiques", mais susceptibles de tomber dans la catégorie des usages "à hauts risques" instituée par le texte.

Cette dernière regroupe des systèmes d'IA utilisés dans certains secteurs jugés sensibles - tels que l'éducation, les ressources humaines, ou encore l'application du droit et la gestion des migrations -, auxquels seront imposées une série d'obligations particulièrement contraignantes.

"Plusieurs de ces dispositions sont très lourdes, comme l'exigence de conserver un historique de l'évolution du système d'IA pendant dix ans, ou celle d'effectuer une évaluation puis un audit des risques que celui-ci pourrait présenter. A cela, le Parlement veut ajouter des évaluations d'impacts sur les droits fondamentaux et sur l'environnement, dont on ne sait pas du tout en quoi elles consisteront à ce stade. Aujourd'hui, une start-up européenne dans l'IA a de quoi être déboussolée", pointe Agata Hidalgo, chargée des Affaires européennes de l'association France Digitale.

Ces obligations apparaissent d'autant plus lourdes aux yeux de cette experte que, selon elle, les critères délimitant ladite catégorie balaient excessivement large. "Par exemple, dans le domaine du droit, des solutions de moteur de recherche de décisions juridiques, qui n'ont pourtant rien de très risqué - contrairement à un système qui aiderait un juge à prendre une décision - seraient aussi concernées, poursuit Agata Hidalgo.

La grande question des IA génératives

"J'entends l'inquiétude, mais il me paraît en même temps inévitable et souhaitable que certains systèmes d'IA qui ont un impact important sur la vie des gens soient réglementés plus strictement, bien qu'il faille évidemment définir les cas d'usage à hauts risques avec soin", objecte Milo Rignell, responsable des travaux de l'Institut Montaigne sur les sujets numériques et de nouvelles technologies. "Plus généralement, je pense qu'il faut adopter une vision davantage 'long-termiste' en matière de compétitivité. A court terme, certaines de ces dispositions vont en effet pénaliser des start-up européennes qui se développent dans l'IA. Mais à plus long terme, ce cadre va canaliser l'innovation vers des systèmes plus sûrs, et dignes de confiance", complète-t-il.

La levée de bouclier est plus massive encore au sujet de l'encadrement proposé des "modèles de fondation" ("Foundation models" en anglais), famille d'innovation à laquelle appartiennent les IA génératives d'images, ou de texte, comme Chat GPT. Le texte du Parlement leur impose des mesures assez similaires à celles des systèmes à haut risques, voire plus contraignantes encore.

De son côté, le Conseil, qui réunit les Etats membres, n'a pas encore clairement pris position. Il a désormais l'occasion de le faire à travers les négociations finales, en trilogue, engagées dès mercredi soir avec les rapporteurs du Parlement, dont l'issue sur le sujet est très incertaine.

La ligne qu'adoptera Paris dans ces pourparlers ne fait en tout cas pas de doute. Fin mai, le ministre délégué chargé de la Transition numérique, Jean-Noël Barrot, avait jugé "excessives" "les obligations d'audit [et de] transparence pour ce type de modèle" inscrites au sein de la version du Parlement, dans une interview à Franceinfo. Ces derniers "font l'objet d'une course effrénée dans laquelle nous ne devons pas nous laisser distancer, sans quoi nous nous enfermerons dans des décennies d'assujettissement et de dépendance technologiques", avait-il expliqué.

"Cet argumentaire implique que les Européens pourraient courir après les innovations de géants américains tels que OpenAI, Meta, ou Google, ce qui me paraît à la fois illusoire et contre-productif", répond Milo Rignell. "Les risques de dysfonctionnement que présentent aujourd'hui les nouveaux systèmes d'IA vont constituer un frein à leur adoption par les acteurs économiques. Dès lors, parvenir à lever ces risques est un enjeu majeur de compétitivité. Avoir un cadre incitatif orientant l'innovation dans cette direction est donc un atout pour l'Europe, et non un handicap", conclut-il. Un défi digne de l'IA.

-Clément Solal, L'Agefi ed: VLV

Agefi-Dow Jones The financial newswire

(END) Dow Jones Newswires

© Morningstar, 2023 - L'information contenue dans ce document est à vocation pédagogique et fournie à titre d'information UNIQUEMENT. Il n'a pas vocation et ne devrait pas être considéré comme une invitation ou un encouragement à acheter ou vendre les titres cités. Tout commentaire relève de l'opinion de son auteur et ne devrait pas être considéré comme une recommandation personnalisée. L'information de ce document ne devrait pas être l'unique source conduisant à prendre une décision d'investissement. Veillez à contacter un conseiller financier ou un professionnel de la finance avant de prendre toute décision d'investissement.